Logs structurés & corrélés • Retries + circuit breakers • Quarantaine & fallback • Idempotence & cohérence • Monitoring & alerting gradué

La gestion des erreurs est essentielle pour concevoir des pipelines de données robustes et fiables, garantissant ainsi un comportement prévisible même dans des conditions inattendues : véritable porte d’entrée vers de l’automatisation intelligente et prédictive.

Les pipelines de données sont la colonne vertébrale des écosystèmes analytiques modernes : ils orchestrent l’ingestion, la transformation et la mise à disposition de données qui alimentent produits, IA et décisions métier.

Mais cette chaîne n’est pas infaillible. Timeouts d’API, données mal formatées, connexions interrompues… sans gestion d’erreurs ni journalisation rigoureuse, ces incidents se traduisent par des systèmes fragiles, des données incomplètes et des heures de diagnostic…

Cet article donne des éléments pour concevoir des pipelines tolérants aux pannes grâce à des stratégies d’error handling et de logging robustes. Vous verrez comment journaliser efficacement (logs structurés et corrélés), surveiller en temps réel (indicateurs et alertes), catégoriser les erreurs (récupérables vs non récupérables), relancer intelligemment (retries, circuit breakers), et échouer avec grâce (quarantaine, modes dégradés, chemins de fallback) sans mettre à terre tout le flux. Nous aborderons aussi les fondations d’idempotence et de vérifications de consistance de bout en bout, indispensables pour rejouer en sécurité et garantir la fiabilité fonctionnelle.

À la clé : des pipelines qui détectent tôt, isolent les erreurs, se rétablissent rapidement et expliquent clairement ce qui s’est passé—afin que vos équipes passent moins de temps à éteindre des feux et plus de temps à créer de la valeur.

Terminologie :

- Logging : logs structurés

- Monitoring : métriques + alertes

- Tracing : corrélation distribuée (trace/span)

La gestion des erreurs (error handling) et la journalisation structurée (logging) sont essentielles pour :

- Minimiser les indisponibilités (Minimizing Downtime)

Détecter vite les incidents et rétablir le service plus rapidement. - Assurer l’intégrité et la complétude des données (Ensuring Data Integrity)

Empêcher l’entrée de données corrompues, appliquer des contrôles de qualité - Préserver la cohérence de bout en bout

Vérifier que les volumes et résultats restent alignés tout au long du pipeline. - Accélérer le diagnostic et la résolution

Produire des messages d’erreur clairs et actionnables pour réduire le temps de traitement des incidents. - Protéger les engagements métier (SLA/SLO)

Surveiller la fraîcheur, la latence et les taux d’échec pour tenir les délais et niveaux de service. - Éviter les effets de bord lors des relances

Pouvoir rejouer un traitement sans doublons ni corruption des données. - Isoler les pannes au lieu de tout bloquer

Continuer le flux en mode dégradé ou mettre en quarantaine ce qui pose problème. - Alerter les bonnes équipes, au bon moment

Notifier selon la criticité pour des réponses rapides et coordonnées. - Renforcer la traçabilité et la conformité

Conserver des preuves “qui, quoi, quand, comment” pour l’audit et la gouvernance. - Réduire les coûts d’exploitation

Moins d’investigations longues, moins de relances massives, plus d’efficacité opérationnelle. - Accroître la confiance et la qualité des décisions

Des données fiables, disponibles et expliquées inspirent confiance aux équipes et aux métiers.

En résumé : une bonne gestion des erreurs et un logging rigoureux transforment un pipeline fragile en système résilient, explicable et prévisible — capable de détecter tôt, contenir, se remettre en fonctionnement et documenter chaque incident, tout en maintenant la qualité et les engagements métier.

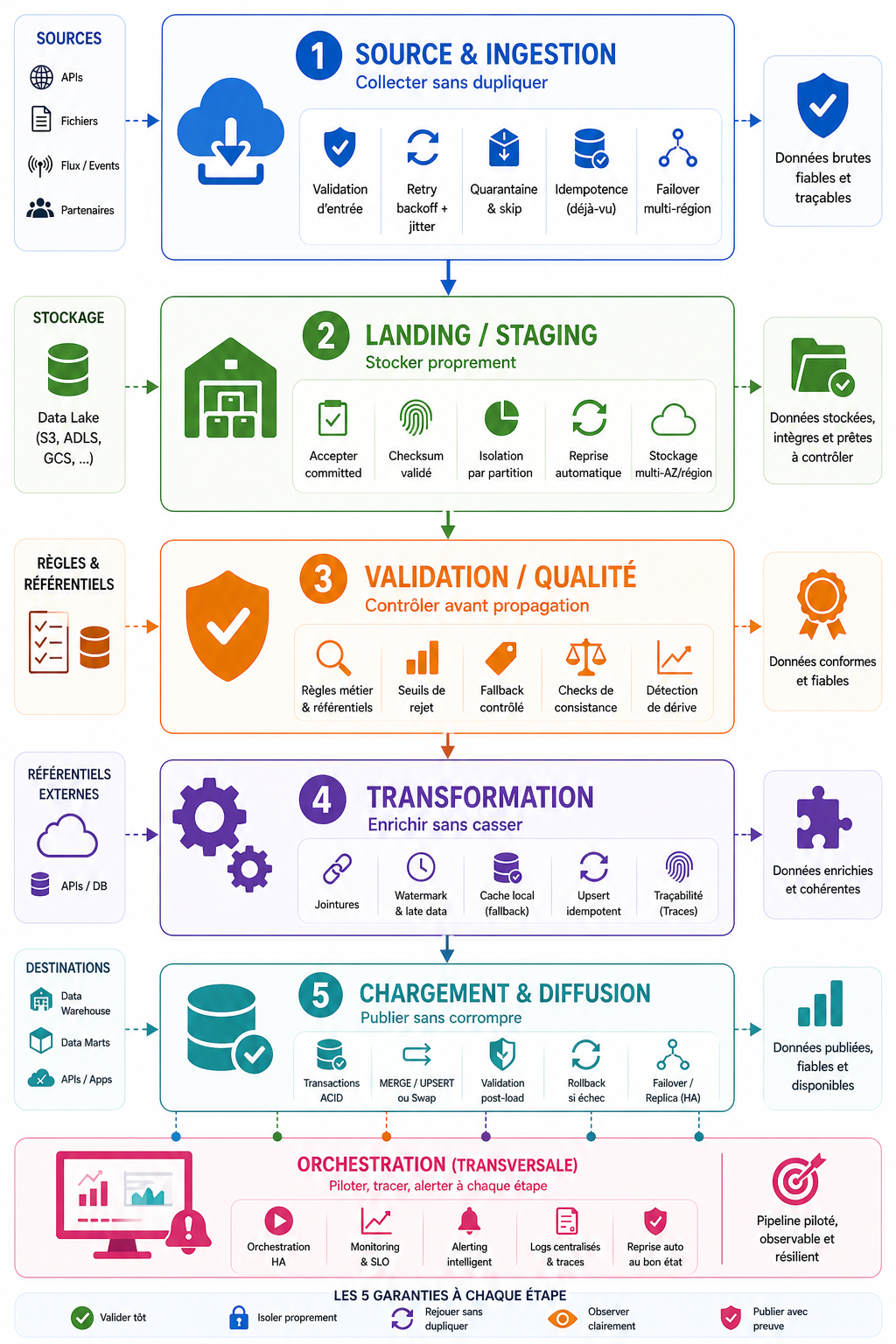

Fiabiliser un pipeline de données de bout en bout

Du chaos des incidents au cycle vertueux de la donnée fiable

Un pipeline de données robuste ne repose pas uniquement sur “des retries et du monitoring”. Il repose sur une chaîne de contrôle cohérente, pensée de bout en bout, où chaque étape :

- détecte les anomalies tôt,

- isole les erreurs sans casser tout le flux,

- garde des preuves,

- limite les duplications,

- et sait continuer intelligemment en mode dégradé.

L’objectif : passer d’un cycle négatif (incidents → corruption → perte de confiance → coûts) à un cycle vertueux :

Données fiables → décisions fiables → confiance → coûts réduits

Vue d’ensemble des couches d’un pipeline résilient

1) Source & Ingestion

Objectif : ingérer sans dupliquer, sans corrompre, sans propager l’erreur.

C’est la zone la plus exposée : APIs, fichiers, événements, partenaires, réseaux. C’est aussi là que commencent les incidents silencieux.

Risques principaux

- pannes réseau / erreurs transitoires,

- rate limits (429),

- erreurs auth / TLS,

- absence de données,

- fichiers partiels,

- mauvais format / encodage,

- volumétrie anormale,

- duplications.

Valider dès l’entrée

Avant toute ingestion, vérifier :

- schéma,

- format,

- encodage,

- colonnes obligatoires,

- domaines autorisés,

- volume attendu vs réel.

Source

↓

[Validation d’entrée]

├─ OK → ingestion

├─ KO mineur → quarantaine

└─ KO critique → rejet2) Landing / Staging

Objectif : stocker proprement avant traitement.

Le staging est la zone tampon. Il doit absorber les défauts sans contaminer la suite.

Risques principaux

- dépôt non atomique,

- corruption,

- checksum mismatch,

- schéma incompatible,

- duplications.

N’accepter que du “committed”

Un artefact n’existe que s’il est explicitement finalisé :

- flag,

- manifest,

- marqueur de commit.

Artefact déposé

↓

Manifest / Commit présent ?

├─ Oui → accepté

└─ Non → rejet3) Validation / Qualité / Contrats

Objectif : arrêter les mauvaises données avant qu’elles deviennent des mauvaises décisions.

La qualité n’est pas un “nice to have”. C’est une barrière de sécurité.

Risques principaux

- nulls inattendus,

- valeurs hors bornes,

- référentiels non résolus,

- dérive de distribution,

- volumétrie anormale.

Appliquer des règles métier explicites

- nullabilité,

- bornes,

- domaines,

- référentiels,

- règles métier.

Tolérer intelligemment

Contrôle qualité

↓

% rejet ≤ seuil ?

├─ Oui → continuer (dégradé)

└─ Non → fail4) Transformation / Enrichissement

Objectif : enrichir sans introduire d’incohérence.

C’est ici qu’on casse souvent la donnée “propre” : jointures fragiles, late data, enrichissements externes instables.

Risques principaux

- jointures incomplètes,

- données en retard,

- désordre temporel,

- erreurs de type / arrondi,

- non-idempotence.

Utiliser les bons patterns

- Event time + watermark

- Retry sur dépendances externes

- Fallback cache local

- Reprocessing ciblé

- Upsert idempotent

- Fingerprints

- Propagation du trace context

Event stream

↓

Watermark

├─ On time → traiter

├─ Late acceptable → traiter

└─ Too late → reprocess cibléMême si l’infra rejoue, la sortie doit rester cohérente : c’est le “exactly once logique”.

5) Chargement / Diffusion (DW, marts, APIs)

Objectif : publier sans corrompre.

C’est la dernière ligne droite — et souvent la plus dangereuse. Une mauvaise publication = mauvaise donnée visible.

Risques principaux

- violations de contraintes,

- deadlocks,

- écritures partielles,

- divergences post-load.

Publier atomiquement

- transaction,

- MERGE / UPSERT,

- partition swap,

- rollback si échec.

Nouvelle version

↓

Validation post-load

├─ OK → promotion

└─ KO → rollbackOrchestration & Plateforme (en transverse de chacune des couches)

Objectif : piloter le système, pas seulement exécuter des jobs.

L’orchestrateur ne sert pas juste à lancer des tâches. Il sert à contrôler le comportement du pipeline.

Risques principaux

- timeouts,

- échecs répétés,

- SLA manqués,

- saturation CPU / mémoire / IO,

- trop de retries.

Solutions

- Encadrer les retries,

- Contrôler la dégradation,

- Centraliser l’observabilité,

Logs + Metrics + Traces

↓

Observabilité

↓

Détection rapide

↓

Réduction MTTRLe vrai changement : passer du “pipeline qui tourne” au “pipeline qui prouve”

Un pipeline fiable n’est pas un pipeline qui “fonctionne la plupart du temps”.

C’est un pipeline qui :

- détecte tôt,

- isole proprement,

- reprend sans dupliquer,

- trace chaque décision,

- prouve ce qu’il a fait.

On ne cherche pas seulement à faire circuler la donnée.

On cherche à rendre son comportement fiable, explicable et gouvernable.

Le schéma mental à retenir

Sans contrôle :

incident → corruption → doute → rework → coûts → perte de confiance

Avec résilience :

détection → isolation → fallback → traçabilité → confiance → coûts réduitsConclusion

La robustesse d’un pipeline n’est pas une feature technique. C’est une propriété systémique.

Chaque couche doit contribuer à 5 garanties :

- Valider tôt

- Isoler proprement

- Rejouer sans dupliquer

- Observer clairement

- Publier avec preuve

C’est ce qui transforme un pipeline fragile en plateforme de confiance. Si vous souhaitez en savoir plus, n’hésitez à nous contacter